Si tu empresa factura entre 1 y 10 millones de euros y has visto cinco posts de LinkedIn esta semana sobre casos de éxito de IA en empresas medianas, ya sabes que casi ninguno aplica para ti. Las cifras llamativas suelen venir de bancos suizos, gigantes farmacéuticos o pilotos coordinados por Microsoft. Lo que se pasa por alto es lo que distingue un caso sólido de un piloto disfrazado en una organización de 10 a 50 personas. Este artículo desglosa cinco patrones reales que aparecen siempre que la implantación funciona, más los errores recurrentes que aparecen cuando se vende como éxito algo que no lo es.

Por qué la mayoría de casos publicados no encajan en una empresa mediana#

Los casos publicados sufren tres distorsiones predecibles. La primera es de escala: un retailer con 800 tiendas y 200 científicos de datos puede absorber un piloto fallido y dejar la pieza en producción mientras se reescribe. Una distribuidora industrial de 30 personas no. La segunda es de presupuesto: la mayoría de los casos se sostienen con equipos que cuestan más que el margen anual de la mediana española. La tercera es de gobierno: las grandes ya tienen capas de datos limpias, equipos de seguridad y procesos documentados; en una empresa mediana esa base no existe y por eso los pilotos se rompen al pasar a producción.

Solo el 26% de las empresas declara obtener valor tangible de la IA en sus operaciones, según el informe BCG Where's the Value in AI? 2024, y en el caso concreto de la IA generativa el 95% de los pilotos empresariales no logra retorno medible al cabo de 24 meses según el informe MIT NANDA State of AI in Business 2025. Estas cifras vienen de muestras donde dominan las grandes corporaciones; en empresas medianas el ratio es peor, no mejor. La buena noticia: los casos que sí funcionan tienen patrones identificables y replicables. En el patrón que instalamos en DelegIA en empresas de 7 y 8 cifras, esa base de gobierno y datos se construye a propósito, capa por capa, antes de que cualquier herramienta entre en producción, no como remiendo posterior.

Patrón 1: la decisión empieza por criterio, no por herramienta#

En el patrón que hemos observado en empresas de 7 y 8 cifras, el error de cabecera de los casos que fracasan es elegir la herramienta primero. La empresa lee sobre Claude, ChatGPT Enterprise o Microsoft Copilot, contrata licencias y luego busca dónde aplicarlas. Los casos que prosperan invierten el orden: parten de una operación concreta donde ya hay fricción, costes claros y una decisión repetitiva, y solo entonces eligen la pieza tecnológica.

Una distribuidora industrial de 40 personas llevaba ocho meses con licencias de un producto generativo de gama alta sin uso medible. Cuando un equipo externo paró a auditar, la operación con más pérdida silenciosa era la cualificación de RFQs entrantes (peticiones de oferta): tres comerciales dedicaban la mitad de su jornada a leer pliegos, contrastar referencias en el ERP y decidir si la oferta merecía respuesta. La herramienta original no resolvía esa pieza porque nunca estuvo diseñada para ella.

El criterio precede al modelo. La pregunta correcta no es "qué hago con la IA", sino "qué decisión cara estoy tomando varias veces al día sin ayuda estructurada". A partir de ahí se elige modelo, se conecta con la fuente de verdad (ERP, CRM) y se mete una capa de validación. El COO que arranca por aquí cierra el primer tramo en semanas, no en meses.

Patrón 2: el caso es operativo y medible, no de marketing#

En los proyectos que hemos visto, los casos que se sostienen comparten un sesgo: están en la trastienda, no en el escaparate. Suben productividad en un proceso interno con métrica antigua y comparable. Bajan tiempo de cierre de un parte, reducen tickets escalados al director, acortan el ciclo de cobranza, eliminan errores de carga manual en el ERP. No suelen ser chatbots de cara al cliente ni vídeos generados; son piezas operativas con un dueño claro.

Si quieres entender cómo se diseña esa pieza operativa antes de elegir herramienta, en la instalación de infraestructura de IA empresarial que ofrecemos en DelegIA arrancamos siempre por una operación con coste medible, no por una promesa.

Una academia de formación profesional online con 25 personas detectó que su soporte tutorial respondía 1.200 mensajes mensuales repetidos sobre las mismas 30 dudas de matrícula y plataforma. La pieza no fue un chatbot público; fue un asistente interno que los tutores humanos consultan antes de responder, alimentado por la base interna de respuestas verificadas. El resultado se midió contra el indicador anterior: tiempo medio de primera respuesta. Pasó de 6 horas a 28 minutos en seis semanas. La métrica era antigua, el dueño estaba claro y la pieza se conectaba a la base de conocimiento existente, no a un GPT genérico, alineado con el patrón que recoge McKinsey en The State of AI 2024. Es la diferencia entre operativa medible y demo de feria.

Patrón 3: hay gobierno coordinado, no GPTs sueltos#

Una empresa mediana puede tener tres GPTs sueltos, cuatro automatizaciones en n8n y un script en Python escondido en el portátil del director financiero. Eso no es un caso de éxito; es deuda técnica disfrazada de innovación. Los casos que escalan tienen un punto único de coordinación que decide qué pieza vive, qué pieza muere y qué pieza pasa a otro departamento.

Llamamos a ese punto la figura del CEO de IA, pero el nombre importa menos que la función: una capa que recibe la operación pendiente, asigna la pieza al agente o departamento correspondiente, audita la salida y reporta al COO lo que se ha hecho. Sin esa coordinación, lo que parece un mosaico de éxitos puntuales acaba siendo un patio donde nadie sabe qué herramienta toca cada cosa. Hay ejemplos prácticos de agentes coordinados que aclaran cómo se reparte el trabajo en una pila ordenada.

La distinción es la diferencia entre una orquesta y cinco solistas tocando a la vez en habitaciones distintas. Cada solista puede ser bueno; el resultado final es ruido. La coordinación es la pieza menos visible y la que más distingue un caso documentado de un caso anecdótico. Las organizaciones con un punto único de gobierno de IA generan retornos varias veces superiores a las que distribuyen iniciativas sin orquesta (Forrester, 2024).

Patrón 4: medido con cifras propias, no con slides ajenas#

Cuando el caso se mide con la cifra del proveedor ("ahorras hasta un 60% en X"), el caso no existe. La cifra existe en el deck del proveedor; el caso no.

Los casos sólidos miden contra el indicador antiguo de la propia empresa. Si antes el cierre de mes tardaba 11 días laborables y ahora 4, esa es la cifra. Si el comercial cualificaba 12 leads al día y ahora 38, esa es la cifra. La medida se hace con la regla que ya usaba el equipo, no con un nuevo dashboard inventado para que la implantación luzca.

En la academia mencionada antes, la cifra del proveedor del modelo decía "ahorra el 70% del tiempo de soporte". La cifra propia, medida contra el ticket interno previo, fue 47% en seis semanas y un alza de la tasa de finalización de cursos del 4 puntos. Las dos cifras importan; la primera no sirve para decidir si la pieza vive o muere, la segunda sí.

Otra señal de caso documentado: la cifra resiste tres meses. Si un piloto luce a las dos semanas y se desinfla a las ocho, no fue un caso, fue un efecto novedad. Documentar la métrica con el mismo método del proceso anterior es lo único que separa mejora estructural de marketing interno.

Patrón 5: el sistema crece sin sumar personal#

El test final de un caso de éxito en empresa mediana no es la métrica del primer mes. Es si la pieza permite asumir más volumen sin contratar a otra persona en los siguientes seis meses. Esa es la definición operativa de palanca.

Una asesoría jurídica de 18 personas implantó una pieza de extracción documental para revisar contratos comerciales. Cifra del primer mes: 32% menos de horas dedicadas. Test al sexto mes: la asesoría aceptó un 28% más de cuentas sin contratar. Ahí el caso se convirtió en infraestructura, no en herramienta.

Cuando el número crece pero la plantilla también, la operación está absorbiendo el ahorro en otra parte (nuevos roles para mantener la pieza, validar errores o gestionar el modelo). Eso no es un caso de éxito; es un cambio de contabilidad. El COO atento revisa los dos números a la vez: volumen procesado y dotación humana asociada. Si solo crece el primero, hay caso. Si crecen los dos al mismo ritmo, no.

Este patrón también filtra las modas. Es habitual ver implantaciones que celebran ahorro de tiempo en una operación mientras añaden, en paralelo, un perfil de prompt engineer y un perfil de revisor de salida. La cuenta neta a doce meses queda plana o negativa, pero los slides internos siguen mostrando el ahorro inicial.

Resolver un patrón que no escala no es contratar un prompt engineer interno, ni añadir otra herramienta SaaS al stack, ni probar un GPT distinto cada trimestre. Es la arquitectura que instalamos para que el ahorro siga vivo a los seis meses, operando dentro de la empresa con el criterio del fundador.

Errores que disfrazan un fracaso como caso de éxito#

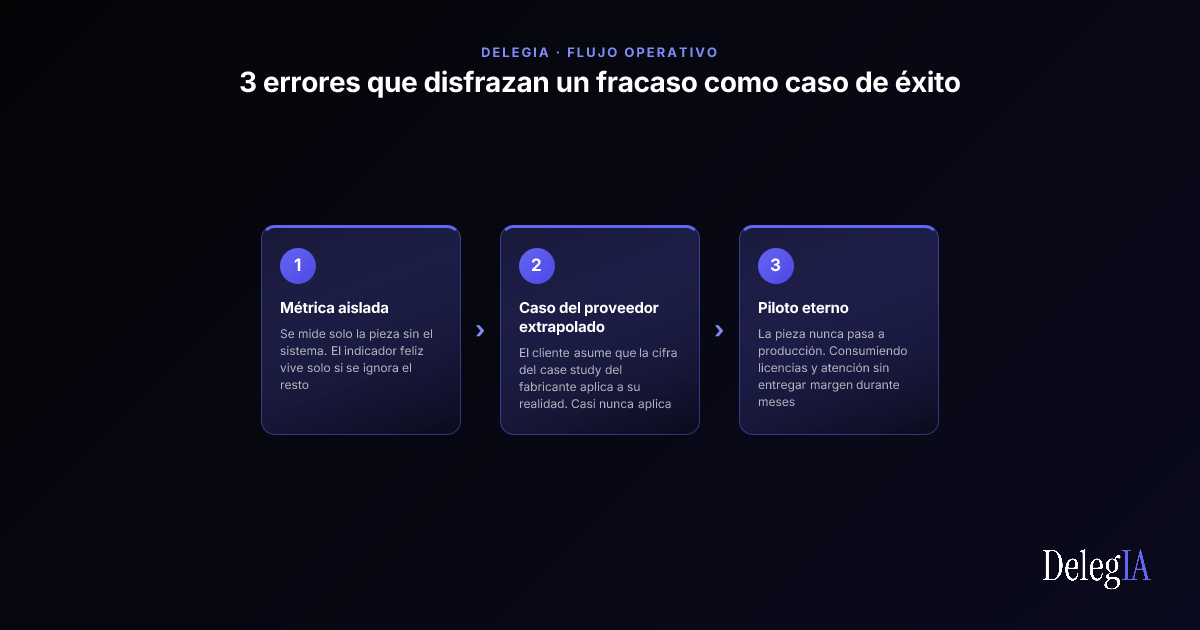

Tres errores aparecen una y otra vez cuando una empresa mediana presenta un caso que no resiste auditoría:

- Métrica aislada. Se mide solo la pieza sin el sistema. El chatbot responde rápido pero los tickets escalados subieron. La conversión del lead crece pero el coste de adquisición también. El indicador feliz vive solo si se ignora el resto.

- Caso del proveedor extrapolado. El cliente asume que la cifra del case study del fabricante aplica a su realidad. Casi nunca aplica: muestra distinta, integración distinta, volumen distinto, equipo distinto.

- Piloto eterno. La pieza nunca pasa a producción. Se queda en "fase exploratoria" durante 14 meses, consumiendo licencias y atención sin entregar margen, patrón documentado por MIT NANDA en State of AI in Business 2025.

El antídoto a los tres es el mismo: una capa de gobierno que decide en plazos cortos si la pieza pasa a producción, se aparca o se mata. Sin esa capa, los pilotos consumen tiempo del COO sin entregar nada medible. Esa capa es lo que distingue una pila técnica estable de cuatro capas de un mosaico de iniciativas inconexas que llamamos casos de éxito de IA en empresas medianas sin serlo. ## Preguntas frecuentes sobre casos éxito IA en empresa mediana

¿Cuánto tarda en estar listo un caso documentado en una empresa mediana?

Entre 4 y 10 semanas hasta producción con métrica medible, contando descubrimiento, instalación y dos iteraciones. Los plazos más cortos suelen ocultar piezas mal integradas. Los plazos de seis meses son una bandera roja: la operación elegida es demasiado ambiciosa o no tiene dueño claro dentro de la empresa.

¿Necesito un equipo interno de IA antes de empezar?

No, pero sí un dueño operativo que tome decisiones. En empresas medianas suele ser el COO, el director de operaciones o un mando intermedio con autoridad sobre el proceso afectado. La capa técnica se puede instalar fuera; la decisión de qué pieza pasa o no pasa a producción tiene que vivir dentro.

¿Cómo distingo un caso documentado de un caso de marketing?

Por tres preguntas: ¿la métrica se midió con la regla previa o con una nueva inventada? ¿la cifra resiste a los tres meses? ¿la empresa absorbió más volumen sin sumar plantilla? Si las tres respuestas son sí, hay caso. Si una o más son no, hay piloto disfrazado.

¿Qué presupuesto realista necesita una empresa mediana para empezar?

Una primera pieza operativa con dueño claro, métrica antigua y conexión a los sistemas internos suele costar entre cuatro y ocho semanas de trabajo concentrado. La capa de gobierno que coordina las piezas posteriores se mantiene con un acompañamiento mensual reducido. La cifra concreta depende del estado de los datos y de cuántos sistemas hay que tocar; lo que no varía es el orden: primero criterio y operación, después tecnología y, solo al final, escala.

Lo que separa un caso documentado de uno anecdótico no es el modelo elegido ni el proveedor; es la capa de gobierno que decide qué pieza vive y qué pieza muere. Sin esa capa, hasta el mejor modelo termina como un solista más en el patio de la empresa.