Hablar de modelos IA en 2026 es como hablar de motores en 1925: el debate ya no es si funcionan, sino cuál encaja con cada uso. La oferta llegó a un punto en el que ningún equipo razonable elige uno solo y lo usa para todo. Un CEO de IA es lo que decide cuándo usar cada modelo. Hay modelos buenos para razonamiento profundo, otros mejores para velocidad, otros para coste, otros para idiomas concretos. Una empresa mediana que ya factura necesita criterio para elegir la IA adecuada para su empresa para no acabar pagando 4 suscripciones a modelos que cubren lo mismo. Este artículo repasa las familias de modelos disponibles, los criterios para elegir y cómo encajar varios dentro de una infraestructura que no se rompa.

Qué se entiende hoy por modelos IA#

Un modelo IA es un sistema entrenado sobre datos para producir un tipo de salida. La distinción importante para una empresa no es la arquitectura técnica, es la familia funcional. En la práctica, hay 6 familias relevantes en 2026:

Modelos de lenguaje grandes (LLM). ChatGPT, Claude, Gemini, Llama, Mistral, DeepSeek, Grok. Producen texto, hacen razonamiento, escriben código, asisten en tareas cognitivas. Es la familia con más opciones y más diferencias entre proveedores.

Modelos de generación de imagen. DALL-E 3, Midjourney, Stable Diffusion, Flux, Imagen 3, Adobe Firefly. Convierten prompts en imágenes. Difieren en estilo, control, derechos comerciales y velocidad.

Modelos de generación de vídeo. Sora, Veo 3, Runway Gen-3, Kling, Pika. Producen clips desde prompts. Familia más reciente, en evolución acelerada.

Modelos de voz y audio. ElevenLabs, OpenAI TTS, Whisper, Resemble AI. Generan voces sintéticas, transcriben audio, clonan voces específicas con autorización.

Modelos multimodales. GPT-5, Gemini 3, Claude Opus 4.6. Procesan texto, imagen, audio y vídeo en el mismo modelo. La frontera entre familias se difumina.

Modelos especializados. Coding (Codex), música (Suno, Udio), traducción (DeepL), análisis de datos (Anthropic con artifacts, OpenAI con Code Interpreter). Familia heterogénea, agrupada por caso de uso.

Esta clasificación es operativa: importa porque define qué proveedor contratar, qué presupuesto destinar y qué decisiones tomar. La taxonomía técnica (transformer, mixture-of-experts, diffusion) tiene su sitio en una conversación de ingeniería; aquí no aporta criterio.

Los modelos LLM más usados en 2026 (y para qué)#

El mercado de IA generativa supera los 67.000 millones de dólares en 2026 y crece a un ritmo del 35% interanual, según el Generative AI Market Report de Grand View Research. El 78% de las empresas globales han adoptado IA en al menos una función, aunque implementar IA en una empresa mediana sigue teniendo sus trampas, según The State of AI de McKinsey. Pero la elección del modelo correcto sigue siendo desordenada en pymes. Estas son las opciones disponibles:

GPT-5 (OpenAI)

Modelo más versátil del mercado. Bueno en casi todo: razonamiento, código, escritura, multimodalidad. Ventana de contexto de 200K tokens. Precio mediano. Disponible vía ChatGPT, API y Microsoft Copilot. Útil cuando se necesita un modelo único que cubra muchas tareas con calidad consistente.

Claude Opus 4.6 (Anthropic)

Líder en Intelligence Index según rankings independientes en abril de 2026. Especialmente fuerte en razonamiento profundo, análisis de documentos largos y código. Ventana de contexto hasta 1 millón de tokens. Tasa de alucinaciones más baja del mercado. Útil para trabajos que requieren rigor: análisis legal, investigación, documentación técnica.

Claude Sonnet 4.6 (Anthropic)

Versión más rápida y barata de Claude. Ideal para tareas de alto volumen donde el coste importa. Líder en código según benchmark SWE-bench (72.5%). Es la opción por defecto para muchos equipos de desarrollo en 2026.

Gemini 3 Pro (Google)

Excelente en multimodalidad y velocidad. Integración nativa con Google Workspace, Gmail, Drive. Ventana de contexto hasta 2 millones de tokens. Útil dentro del ecosistema Google y para tareas con material visual abundante. Más débil que Claude o GPT en razonamiento puro.

Llama 4 (Meta)

Modelo open source. Llama 4 Scout llega hasta 10 millones de tokens de ventana de contexto. Útil para equipos que necesitan ejecutar modelos en su propia infraestructura por razones de privacidad, coste a escala o personalización. Requiere capacidad técnica para desplegar.

Mistral Large 3 / Mistral Medium

Alternativa europea con mejor rendimiento por euro en muchas tareas. Útil para empresas con preferencia por proveedores europeos por GDPR o por geografía.

DeepSeek-V3.5

Modelo chino con rendimiento competitivo y precio agresivo. La cuestión de la jurisdicción y el flujo de datos es importante en empresas con datos sensibles. Útil cuando el coste es prioritario y los datos no son críticos.

Grok 3 (xAI)

Integrado en X. Bueno para investigación con acceso a información reciente. Caso de uso acotado. Menos relevante para uso operativo en pymes.

Comparativa rápida de modelos IA por caso de uso#

| Caso de uso | Modelo principal | Alternativa | Razón |

|---|---|---|---|

| Razonamiento profundo y análisis | Claude Opus 4.6 | GPT-5 | Menos alucinaciones, mejor con documentos largos |

| Código y desarrollo | Claude Sonnet 4.6 | GPT-5.3 Codex | Mejor benchmark SWE |

| Tareas multimodales (imagen + texto) | Gemini 3 Pro | GPT-5 | Mejor integración visual |

| Generación de contenido masivo | GPT-5 | Claude Sonnet | Versatilidad y velocidad |

| Automatización de alto volumen barata | Claude Haiku | Gemini Flash | Mejor coste por token |

| Datos sensibles on-premise | Llama 4 / Mistral | DeepSeek (con cuidado) | Despliegue interno |

| Atención al cliente con voz | GPT-5 + ElevenLabs | Gemini Live | Latencia y naturalidad |

| Investigación con web reciente | Perplexity / Grok | Gemini con Search | Acceso a información actual |

La elección no es "cuál es el mejor". Es cuál encaja con la tarea recurrente y el presupuesto disponible. Una empresa puede acabar usando 3 o 4 modelos distintos coordinados por una capa que decide cuál llamar para cada tipo de petición.

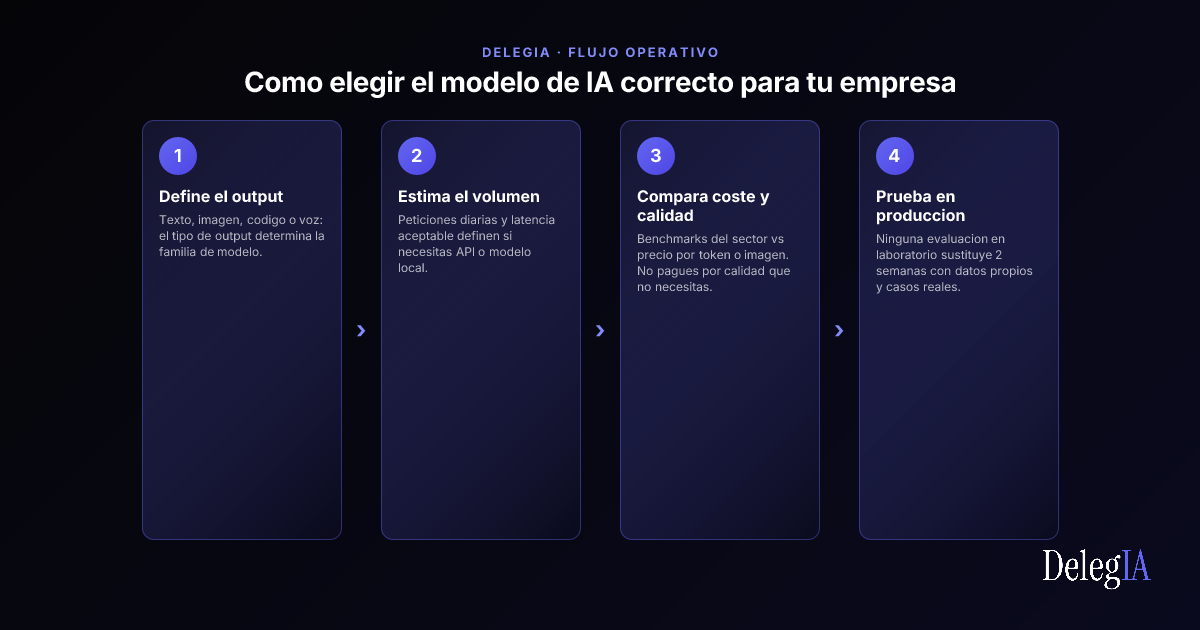

Cómo elegir entre modelos IA: 5 criterios operativos#

Criterio 1: Caso de uso recurrente. No es lo mismo escribir 10 emails al día que analizar 200 contratos al mes. Para el primero, GPT-5 vía Copilot. Para el segundo, Claude Opus 4.6 con su ventana de contexto extensa. La pregunta correcta es: ¿qué tarea se repite y cuántas veces al mes?

Criterio 2: Coste por token al volumen estimado. Un modelo que cuesta 0.003 euros por 1K tokens parece barato hasta que el equipo procesa 50 millones de tokens al mes. Hacer la cuenta con datos verificados del último trimestre evita sorpresas. Las APIs ofrecen tarifas distintas según volumen, conviene revisarlas.

Criterio 3: Privacidad y jurisdicción de datos. Algunas empresas no pueden enviar datos a proveedores fuera de la UE. Otras tienen contratos con cláusulas que obligan a cifrado en reposo. Antes de elegir un modelo, revisar el data processing agreement del proveedor. Una multa GDPR cuesta más que cualquier suscripción.

Criterio 4: Integración con la pila existente. Un equipo que ya está en Microsoft 365 ahorra implantación con Copilot. Un equipo en Google Workspace lo hace con Gemini. Forzar otro proveedor por cifras de benchmark a veces no compensa el coste de cambio.

Criterio 5: Capacidades específicas no negociables. Si el caso de uso requiere ventana de contexto larga, descartar modelos con menos. Si requiere voz natural, descartar modelos con TTS pobre. Si requiere multimodal, descartar modelos solo de texto. Listar las restricciones antes de probar reduce el ruido del mercado.

Errores comunes al elegir modelos IA en una empresa#

Error 1: elegir por moda y no por caso de uso. En el patrón que hemos observado en pymes, cada vez que sale un modelo nuevo, hay equipos que se mueven sin medir. El coste de cambio (re-prompts, re-integración, re-formación del equipo) suele superar la mejora de calidad. Revisar el modelo cada 6 meses, no cada 2 semanas.

Error 2: usar el modelo más caro para todo. Pagar GPT-5 con razonamiento extendido para clasificar emails de soporte es como contratar un consultor senior para abrir cartas. Los modelos pequeños (Claude Haiku, Gemini Flash, GPT-4 mini) cubren el 70% de tareas a una décima parte del coste.

Error 3: ignorar el control de versiones del modelo. Los proveedores actualizan los modelos sin avisar. Un prompt que funcionaba ayer puede dar otra salida hoy. En la mayoría de casos que llegan a nosotros, las empresas con criterio fijan versiones específicas en producción y solo actualizan tras tests.

Error 4: no medir alucinaciones ni precisión. El 40% de las empresas que adoptan IA reportan al menos un incidente de salida incorrecta publicada, según el Stanford AI Index Report 2025. Sin medir alucinaciones, no se sabe si el modelo es lo bastante fiable para el caso. Establecer un baseline de calidad antes de escalar.

Error 5: no documentar prompts. Un modelo es tan bueno como el prompt que recibe. Según los casos que hemos instalado, las empresas que tratan el prompt como código (versionado, revisado, mejorado) producen mejor que las que lo improvisan. Un repositorio de prompts es tan importante como un repositorio de código en 2026.

Cuándo usar varios modelos IA en paralelo#

Una empresa mediana que ya factura no necesita un solo modelo. Necesita una pila. El patrón que funciona:

- Modelo principal de razonamiento. Claude Opus 4.6 o GPT-5. Para tareas que requieren juicio.

- Modelo barato de alto volumen. Claude Haiku, Gemini Flash, GPT mini. Para clasificación, resumen masivo, primera capa de filtrado.

- Modelo especializado en código. Claude Sonnet 4.6 si hay equipo de desarrollo.

- Modelo multimodal. Gemini 3 Pro o GPT-5 para procesar facturas, contratos escaneados, capturas.

Esta pila típica cuesta entre 200 y 800 euros al mes para una empresa de 30-50 personas. Los ahorros vienen de usar el modelo barato para el volumen y el caro solo cuando hace falta. Sin esta lógica, todo va al modelo caro y el coste se dispara.

Cómo encajar los modelos IA dentro de una infraestructura coherente#

El modelo no es la pieza importante. La pieza importante es la capa que decide qué modelo llamar para cada brief, mantiene los prompts versionados y asegura que la salida cumple las normas internas. Sin esta capa, la empresa tiene 4 suscripciones, 4 equipos usándolas distinto y 0 control sobre qué se publica con sello de la marca.

DelegIA estructura esta pila como una arquitectura, no como una colección de herramientas. Un CEO de IA decide qué modelo se invoca para cada tipo de tarea. Los agentes operativos (contenido, ventas, operaciones) consumen modelos a través de esa capa, no directamente. El equipo humano define las reglas; los modelos las ejecutan; el sistema mide y mejora. Esto evita que la empresa pague por capacidades duplicadas o por suscripciones que nadie usa al cabo de 3 meses.

Para entender cómo se conectan estos componentes en una operativa concreta, conviene revisar cómo se instalan agentes de IA en empresas medianas. Modelos IA es una pieza dentro de una arquitectura más amplia que también cubre orquestación, gobernanza, medición y gobierno del dato.