La estadística es incómoda: más del 80% de los proyectos de IA en empresas no llega a generar impacto medible. La pregunta de por que fracasan los proyectos IA PYME lleva años sin respuesta clara porque se busca en el sitio equivocado. La respuesta habitual apunta a la tecnología: modelos inadecuados, proveedores que no entregan, herramientas que no encajan. Pero eso no es lo que muestran los datos. El problema casi nunca es técnico. Es estructural. Y entender esa diferencia determina si el próximo intento tiene resultado o acaba como los anteriores.

Para el director de operaciones que ya ha visto caer un piloto o dos, este artículo no intenta convencerle de que la IA funciona. Eso ya lo sabe. Lo que intenta es nombrar exactamente dónde se rompe el proceso para que el siguiente intento no repita los mismos errores.

La confusión entre piloto eterno y proyecto que produce valor#

El 42% de las empresas abandonó la mayoría de sus iniciativas de IA en 2025, frente al 17% del año anterior. No porque la tecnología falle. Sino porque se queda atrapada en la fase de piloto.

El patrón es conocido: la empresa arranca un piloto con energía, demuestra que la IA funciona en un caso pequeño, y luego el proyecto no pasa a producción. El equipo de operaciones no sabe cómo integrarlo en el día a día. El responsable del piloto cambia de posición. El contexto inicial ya no aplica. El piloto muere por falta de estructura, no por falta de tecnología.

En un despacho de consultoría de 18 personas que implantó un sistema de IA para gestión documental, el piloto funcionó correctamente en las primeras dos semanas. El responsable de operaciones tenía claro cómo usarlo. Cuando salió de vacaciones tres semanas, nadie lo tocó. Al volver, el equipo había retomado el proceso manual. El sistema existía técnicamente. La empresa no lo había adoptado.

Un piloto que no escala no es un avance. Es un coste con aprendizaje cero.

La diferencia entre un piloto que escala y uno que muere está en si existe una definición de qué ocurre después de que el piloto demuestra que funciona. Sin esa definición, el piloto no tiene continuación posible aunque los resultados sean buenos.

Los datos llegan sucios y nadie lo dice antes de empezar#

Gartner estima que hasta el 60% de los proyectos de IA serán descartados para 2026 por falta de datos listos para IA. La causa concreta: los datos que alimentan los sistemas no están estructurados, no son consistentes o provienen de fuentes que nadie ha auditado en años.

La IA funciona como una cocina con receta. La receta puede ser perfecta: el proceso está documentado, los pasos están claros, el resultado es reproducible. Pero si los ingredientes llegan en mal estado, la receta no salva el plato. Lo que entra determina lo que sale.

Una PYME con siete años de operativa acumulada tiene datos en cuatro sistemas distintos que no hablan entre sí, historiales con campos vacíos, registros duplicados y convenciones que cambiaron dos veces en el último lustro. Instalar un agente de IA sobre esa base no produce resultados coherentes. Amplifica el desorden con mejor presentación.

El error más frecuente es asumir que la IA va a limpiar los datos por sí sola. No lo hace. Un sistema de IA procesa lo que recibe. Si recibe inconsistencias, genera inconsistencias con mayor velocidad y menor coste unitario. En los proyectos que hemos visto, la calidad del output es proporcional a la calidad del input.

Para entender cómo construir esa base de forma coherente, vale la pena revisar el concepto de infraestructura de IA empresarial de 4 capas: la primera capa siempre es de datos, no de agentes.

La ausencia de gobernanza convierte el sistema en caos coordinado#

Cuando se instala un sistema de IA sin definir quién decide qué, el resultado es predecible: cada persona del equipo lo usa de forma diferente, los outputs son inconsistentes y nadie sabe cuándo fiarse del sistema y cuándo no.

Gobernanza en IA no es burocracia. Es responder tres preguntas antes de arrancar:

¿Quién aprueba los outputs del sistema antes de que lleguen al cliente o al proceso siguiente? ¿Quién escala una excepción cuando el agente no tiene criterio para resolverla? ¿Quién valida que el sistema sigue funcionando correctamente en tres meses?

Sin esas respuestas definidas, el sistema de IA opera en un vacío de responsabilidad. El equipo aprende a ignorarlo cuando falla y a usarlo de forma oportunista cuando funciona. No hay ciclo de mejora, no hay criterio de calidad, no hay forma de saber si el sistema es un activo o un problema.

La diferencia entre un proyecto que funciona y uno que se abandona no está en la sofisticación del modelo. Está en si existe una estructura humana que lo gobierna y lo mantiene. Esa estructura incluye un propietario del sistema, un protocolo de excepción y una revisión periódica que detecta fallos antes de que se conviertan en abandono definitivo.

El alcance inicial ataca el problema equivocado#

La mayoría de proyectos de IA en empresas medianas empieza por donde se puede, no por donde más impacta. El departamento más dispuesto, el responsable más entusiasta, el caso de uso más fácil de demostrar. El resultado: se automatiza un proceso que no era el cuello de botella principal.

Un director de operaciones que gestiona el ciclo de entrega ve que el cuello de botella está en la coordinación interna entre departamentos. El proyecto de IA se lanzó para generar informes más rápido. Los informes salen en la mitad de tiempo. La coordinación sigue siendo el problema. El cliente no nota mejora. El director descarta la IA como ineficaz. La IA no falló. Resolvió el problema equivocado.

La selección del caso de uso inicial es una decisión estratégica, no técnica. Determina si el sistema de IA va a producir un resultado visible en 90 días o va a quedarse como experimento interno sin adopción efectiva.

Los distintos tipos de agentes de IA resuelven problemas distintos: un agente de coordinación no sirve para lo mismo que uno de análisis o de generación de contenido. Elegir mal el tipo de agente para el problema es tan costoso como elegir mal el problema.

El diagnóstico correcto del cuello de botella principal es el paso que la mayoría de empresas se salta porque quiere demostrar resultados rápido. Y esa prisa es exactamente lo que hace que los resultados no lleguen.

El equipo no sabe cómo operar con IA y nadie se lo enseña#

El 35% de las empresas cita la falta de habilidades internas como obstáculo principal para que sus iniciativas de IA generen valor. No se trata de que el equipo no sepa usar herramientas. Se trata de que nadie les ha explicado cuándo confiar en el sistema, cómo detectar cuando falla, y qué hacer cuando el output es incorrecto.

En el patrón que hemos observado en empresas 7-8 cifras, un agente de IA instalado sin onboarding del equipo dura tres semanas en producción. La primera semana el equipo lo usa con curiosidad. La segunda, encuentra casos donde el output no está bien. La tercera, vuelve al proceso manual porque "es más fiable". El sistema sigue activo técnicamente. La empresa lo ha abandonado operativamente.

La preparación del equipo no es un paso posterior a la instalación. Es parte de la instalación. Sin criterios claros de uso, sin ejemplos de cuándo escalar al humano, sin métricas de calidad que el equipo pueda verificar por sí mismo, el sistema de IA se convierte en un activo que nadie mantiene y que nadie mejora.

Esto no requiere que el equipo se convierta en experto técnico. Requiere tres cosas concretas: saber qué hace el sistema, saber cuándo no confiar en él, y saber a quién escalar cuando aparece un caso que el sistema no resuelve bien. Sin esos tres elementos, el sistema funciona en el vacío.

La medición llegó después de instalar, no antes#

Sin KPI definidos antes de arrancar, no hay forma de saber si el sistema funciona. Esta afirmación parece obvia. En la práctica, la mayoría de proyectos arranca sin métricas de éxito claras establecidas de antemano. Se instala el sistema, se espera a ver qué pasa, y tres meses después alguien pregunta si "está funcionando".

Sin línea base documentada, sin métrica de comparación, sin criterio de éxito definido previamente, la respuesta es inevitablemente subjetiva. El proyecto se evalúa por sensación, no por dato. Y cuando la evaluación es subjetiva, la decisión de continuar o cancelar también lo es. Lo que debería ser una decisión de negocio se convierte en una opinión política interna.

La medición no es el último paso de un proyecto de IA. Es el primer paso de diseño. Definir qué se va a medir antes de instalar nada obliga a clarificar qué problema se está resolviendo, en qué escala y con qué criterio de éxito. Ese ejercicio, hecho correctamente, también revela si el caso de uso elegido tiene posibilidades concretas de producir un resultado medible en el horizonte temporal que la empresa puede sostener.

Para una empresa que quiere evitar estos errores desde el inicio, el proceso comienza por entender cómo implementar inteligencia artificial en una empresa con una secuencia que empieza por el diagnóstico y las métricas, no por la herramienta.

Lo que diferencia un proyecto que funciona del que no#

En los proyectos que hemos visto, el patrón detrás del fracaso en empresas medianas es casi siempre el mismo: la empresa trata la instalación de IA como un proyecto de tecnología cuando es un proyecto de adopción organizacional. La diferencia no está en el modelo ni en el proveedor. Está en la estructura que rodea al sistema.

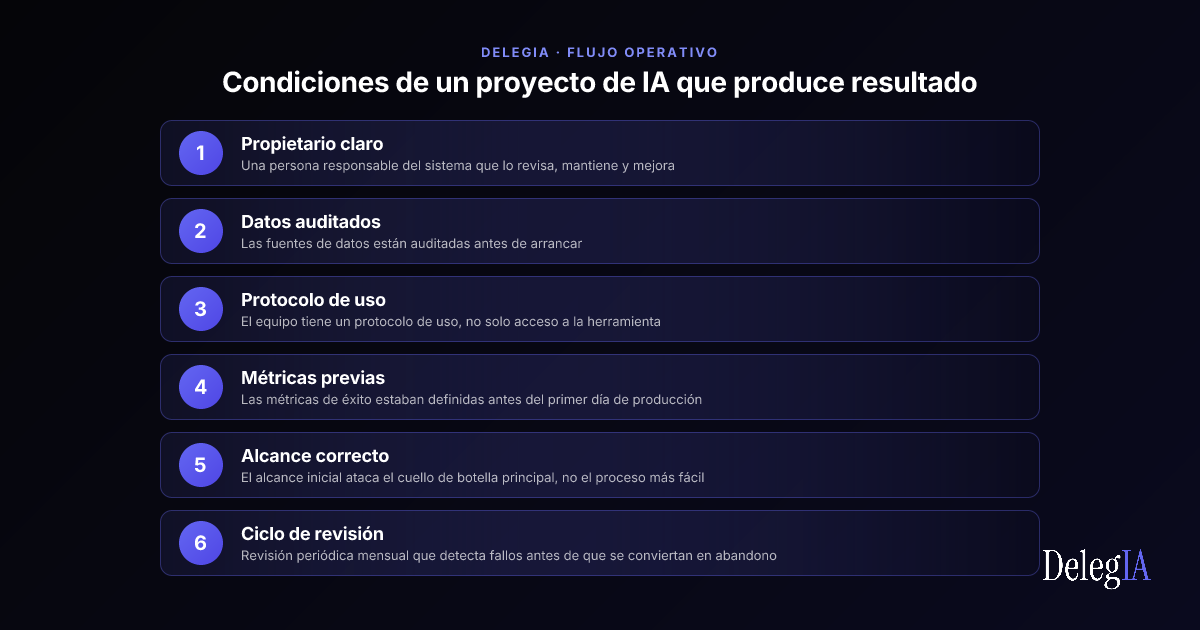

Los proyectos que producen resultado comparten seis condiciones que ninguna es tecnológica. Tienen propietario claro: una persona responsable del sistema que lo revisa, lo mantiene y lo mejora. Las fuentes de datos están auditadas antes de arrancar. El equipo tiene un protocolo de uso, no solo acceso a la herramienta. Las métricas de éxito estaban definidas antes del primer día de producción. El alcance inicial ataca el cuello de botella principal, no el proceso más fácil de demostrar. Y hay un ciclo de revisión periódico, normalmente mensual, que detecta fallos antes de que se conviertan en abandono definitivo.

La tecnología de IA disponible hoy para una empresa mediana es suficientemente buena para producir resultado en casi cualquier proceso que se elija correctamente. El cuello de botella no está en el modelo. Está en la estructura que lo rodea.

Una empresa que instala IA sin resolver gobernanza, datos, alcance, preparación del equipo y medición tiene exactamente las mismas probabilidades de éxito que alguien que monta una cocina de alta gama sin recetas ni criterio para usarla. El equipamiento existe. La cocina no produce.

Si quieres saber cómo DelegIA instala infraestructura que funciona desde el primer día, contacta con nosotros.